从ChatGPT的对话到自动驾驶的决策,人工智能正在以前所未有的速度改变人类生活。但你是否好奇:“AI究竟靠哪些核心技术实现智能跃迁?”本文将为大家解读AI领域十大常见关键词,为你揭开AI世界的神秘面纱。掌握这些概念,你不仅能看懂科技新闻,还能在AI产品体验中洞察技术本质!

1 大模型(LargeLanguage Models)

大模型(LLM)相信大家必然不会陌生,其指的是参数规模超千亿的深度学习模型,通过海量数据训练获得跨领域通用能力。日常生活中常见的有ChatGPT、文心一言等。2025年,行业大模型(DomainLLMs)成为主流,医疗、金融等领域纷纷推出定制化模型,通过行业数据训练提升专业决策能力,例如,医疗大模型可辅助诊断,金融大模型能预测市场风险。而在实际项目中,常见地将领域知识注入基座模型的方法主要包括微调(Fine-Tuning)和检索增强生成(RAG)。

2 微调(Fine-Tuning)

微调(Fine-Tuning)是人工智能领域的关键技术,指基于通用领域预训练的基座大模型(如BERT、GPT等),通过引入特定领域的标注数据或任务目标,对模型参数进行针对性调整地再训练过程。其核心目的是让大模型从通用语义理解转向专业领域适配,提升特定场景下的任务表现。

经过技术积累,目前最主流的微调方法为LoRA,通过调整0.1%-1%参数即可达到全参数微调效果,显著降低计算成本。但需要注意的是模型微调虽然能提升在专业领域的任务效果,但会出现过拟合风险和灾难性遗忘,严重影响模型准确度。

3 检索增强生成(RAG)

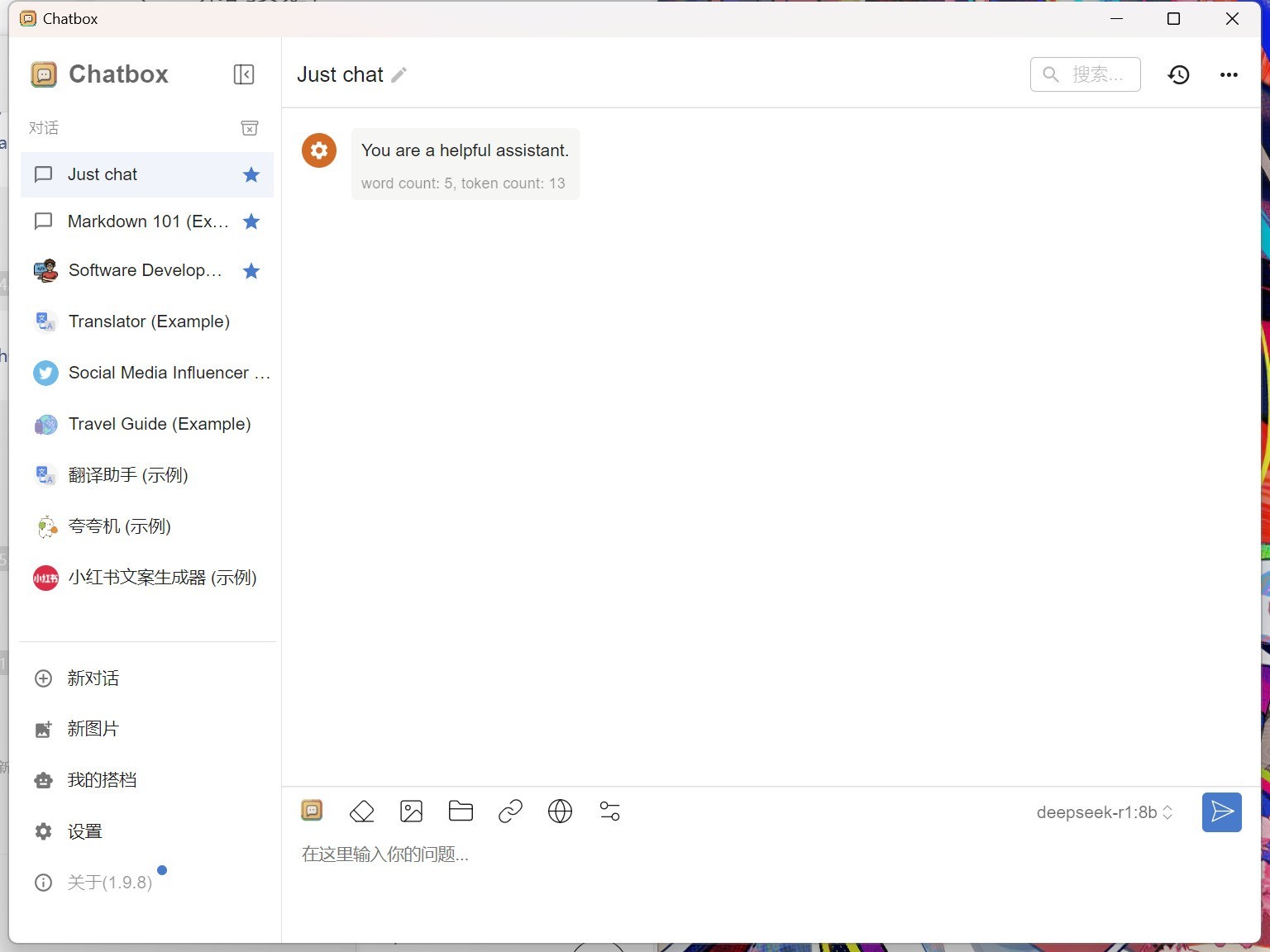

相比微调,RAG会更加适合一般用户,其不需要重新训练模型,只是需要构建好领域知识库,模型在推理阶段会自行检索相关文档,辅助模型生成更准确的回答,有点类似于目前比较常见的“联网搜索”。

不过虽然它不需要额外的算力,但它却十分依赖检索质量,知识库构建需要十分注意,否则会影响结果相关性;并且对于需要深度逻辑链的问题(如数学证明),RAG可能弱于微调后的专用模型。

4 深度求索(DeepSeek)

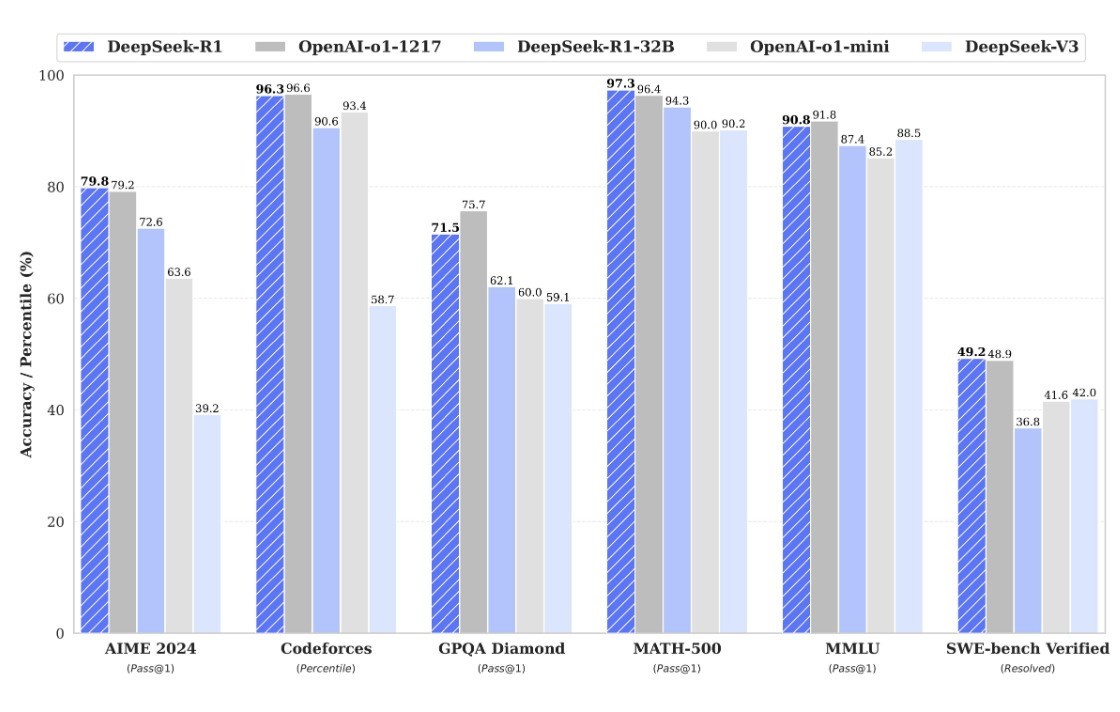

大家目前所说的DeepSeek包含两层意思,一方面指代深度求索这家人工智能领域的公司,另一方面则指代由这家公司在春节期间发布并开源的大模型DeepSeek-R1,通过采用混合专家模型(MoE)、多头潜在注意力(MLA)等架构,无需占用大量显存即可完成推理过程,并且在数学竞赛题、代码生成等任务中准确率超越GPT-4,生成速度提升3倍,以“四两拨千斤”的奇效彻底打破深度学习领域唯显卡论的说法。

5 Transformer架构

Transformer架构是深度学习领域的革命性突破,其基于自注意力机制的设计彻底改变了人工智能处理序列数据(尤其是自然语言)的方式,并成为大模型时代的核心架构。不夸张地说Transformer架构可以说是深度学习领域得以发展壮大的基石,其彻底改变了AI处理语言的方式。

Transformer不仅重塑了NLP技术体系,更推动AI向通用人工智能迈进。其设计思想(如注意力即插即用、并行化架构)已渗透到计算机视觉、生物计算等领域,成为深度学习发展的核心驱动力。随着模型压缩、硬件加速等技术的发展,Transformer将继续拓展人工智能的应用边界

6 卷积神经网络(ConvolutionalNeural Network,CNN)

卷积神经网络(CNN)并不是一个新技术,其发展历程可追溯到20世纪80年代,但早期因受限于计算能力等原因,应用场景比较单一。卷积神经网络(CNN)的概念相对来说比较复杂,它是一种专为处理网格状数据(如图像、视频、音频等)设计的深度学习模型,其核心思想是通过局部感知、参数共享和层次化特征提取实现对输入数据进行高效处理。

概念上虽然复杂,但对大部分用户来说,只需要知道目前CNN主要应用于图像领域,包括自动驾驶、人脸识别、文生图模型等任务。除了CNN外,还有像循环神经网络(RNN)、图神经网络(GNN)等这类应用于其他不同任务的神经网络。

7 Token

Token是自然语言处理(NLP)中文本处理的最小单位,可以是单个字符、字词、词组或标点符号,例如:中文句子“我经常玩射击游戏”可能拆分为:[我,经常,玩,射击游戏]。但需要注意的是Token的拆分并不仅遵循以上规则,根据模型的不同分割的方法也有所区别。

Token作为AI模型的最小单元,直接影响计算效率、生成质量和应用成本。当前技术通过优化分词策略、扩展上下文窗口逐步突破限制,但在长文本处理、多语言兼容性上仍需改进。未来,随着模型压缩和分布式计算的发展,Token处理的效率与精度将进一步提升

8 知识蒸馏(KnowledgeDistillation)

我们知道大模型在性能方面的强大有目共睹,但想要在本地部署一台成本又太高,这个时候通过知识蒸馏技术就能将千亿参数大模型压缩成手机都能运行的小模型。事实上知识蒸馏是一种通过迁移大模型(教师模型)的泛化能力到小模型(学生模型)的模型压缩技术,其核心在于将大模型学习到的“知识”提炼到轻量级模型中,解决本地部署算力与成本问题。

通过知识蒸馏,原本需数千万成本的千亿参数大模型可压缩为手机端可运行的轻量级模型,在降低硬件门槛的同时保留核心性能,成为AI普惠化的重要技术路径。但教师-学生模型结构差异过大会导致知识迁移效率下降,这个时候就需要结合RAG和微调技术对蒸馏模型进行升级。

9 提示词

在AI领域中,提升词通常指通过优化输入指令(即“提示词”或“关键词”)来引导AI模型生成更高质量、更精准的输出结果。就如同领导向员工传达任务目标一样,对于AI来说你就是它的领导,你的输入指令的精准性以及专业性能够极大提升模型的输出质量以及输出效率。

俗话说得好“将相无能,累死三军”,虽然AI不会累死,但你的输入以及AI的输出都会换算为Token,而这些Token又会积累成金钱,所以为了自己充值的money不会白白损失,学习如何精准地提问将会是AI时代必备的才能。

10 Offloading技术

众所周知,显存的价格要远高于内存,尤其是对于普通用户来说。以DeepSeek-R1631B4bit量化为例,想要纯通过显卡部署并进行推理需要8张A100显卡才能运行,成本颇高。

而想要使用更低的显存进行推理,除了我们之前讲过的知识蒸馏外还有模型量化以及混合推理,模型量化这块,我们下期再来解释,这次我们先来看看混合推理,顾名思义就是将对象卸载到外部资源或将其分布在多种设备上以减少主设备的内存负载,常用于在GPU显存有限的设备上优化内存使用。

本文属于原创文章,如若转载,请注明来源:AI十大关键词!了解这些你就是半个AI达人https://diy.zol.com.cn/955/9556509.html